Kiedyś pytaliśmy bliskich o to, czy dobrze wyglądamy i co możemy zrobić, aby wyglądać lepiej. Dziś coraz więcej osób szuka odpowiedzi nie u przyjaciół, czy partnerów, ale u sztucznej inteligencji. O zaskakującym i niepokojącym trendzie pisze dziennikarka Tatum Hunter w swoim artykule dla The Washington Post. Autorka przygląda się, jak ChatGPT staje się cyfrowym doradcą w sprawach urody, często zastępując realne rozmowy z bliskimi.

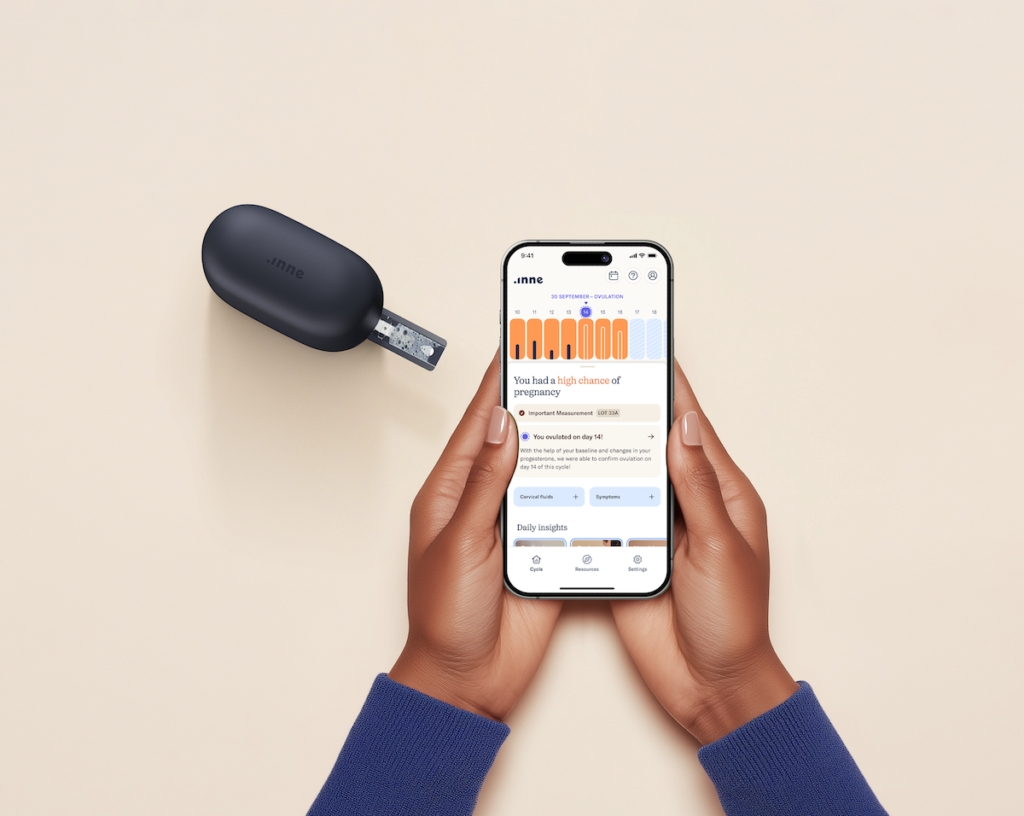

Ania Rucinski, 28-latka z Los Angeles, regularnie korzysta z ChatGPT, by zapytać go, jak wygląda jej cera albo czy wybrana stylizacja pasuje do jej sylwetki. Jak czytamy w artykule, który ukazał się na łamach The Washington Post1, Ania nie jest wyjątkiem – to przedstawicielka rosnącej grupy kobiet, które codziennie proszą chatboty o rady dotyczące wyglądu. Dla wielu z nich to bezpieczna przestrzeń: AI nie ocenia, nie zawstydza, nie porównuje z innymi. „Sztuczna inteligencja nie jest zazdrosna, nie rywalizuje, nie wywołuje kompleksów. Jest dostępna 24/7 i nie mówi: ‘Przesadzasz’” – uważa Rucinski w rozmowie z Hunter.

SZTUCZNA PRZYJACIÓŁKA CZY CYFROWY KRYTYK?

Dziennikarka zauważa, iż choć z pozoru niewinne pytania w stylu „czy dobrze wyglądam w tej sukience?” mogą wydawać się nieszkodliwe, to ich konsekwencje są bardziej złożone. Chatboty – choćby jeżeli zaprogramowane tak, by odpowiadać empatycznie – nie mają kontekstu społecznego, nie widzą osoby pytającej i bazują na danych, które często powielają stereotypy i nierealistyczne standardy urody.

Czy sztuczna inteligencja zastąpi psychologa, a seks będziemy uprawiać z robotami? – czytaj dalej

Od końca 2022 roku ChatGPT zyskał globalną popularność – początkowo jako pomocnik w pisaniu maili czy rozwiązywaniu problemów naukowych. Dziś coraz więcej osób traktuje go jak wirtualnego doradcę od… urody. Użytkowniczki proszą o ocenę wyglądu na podstawie zdjęć i pytają, co mogą poprawić. W odpowiedzi dostają listy kosmetyków, zabiegów, a czasem sugestie botoksu – i chętnie się do nich stosują.

To, co uważamy za neutralną opinię AI, często jest kalką uprzedzeń zawartych w danych, na których model był trenowany – ostrzega dziennikarka.

CZY SZTUCZNA INTELIGENCJA JEST OBIEKTYWNA?

Dla wielu osób zaletą bota jest jego pozorna bezstronność. Nie zna ich osobiście, nie kieruje się sympatią – ocenia „na chłodno”. To bywa odświeżające, zwłaszcza w odróżnieniu od cukierkowych opinii rodziny czy przyjaciół. Ale czy AI rzeczywiście jest obiektywna?

Eksperci podkreślają, iż chatboty, w tym ChatGPT, bazują na danych z internetu – także tych, które promują mizoginię, nierealne standardy piękna czy uprzedzenia kulturowe. Choć twórcy ChatGPT, firma OpenAI, nie ujawniają szczegółowo, na jakich danych trenowano ich modele, to – jak mówi Alex Hanna, dyrektorka badań w Distributed AI Research Institute – można przypuszczać, iż uwzględniono m.in. internetowe fora, gdzie ludzie oceniają wygląd innych (głównie mężczyźni oceniający kobiety), takie jak subreddit r/RateMe czy strona Hot or Not.

Dlaczego młodzi ludzie wolą rozmawiać o seksie z botami? Czytaj dalej

Jak mówi Emily Bender, językoznawczyni i krytyczka AI: „Automatyzujemy męskie spojrzenie”. Inaczej mówiąc: bot powiela to, co najczęściej powtarza się w sieci – a to często dalekie jest od życzliwości czy inkluzywności.

CIAŁO POD LUPĄ ALGORYTMU

Za rekomendacjami bota mogą też stać konkretne interesy. Jak ostrzegają analitycy, funkcje zakupowe w ChatGPT i innych narzędziach AI są coraz częściej powiązane z reklamami i promocją konkretnych produktów. Użytkownik nie zawsze wie, czy sugestia wynika z analizy potrzeb, czy… z płatnej współpracy. A iż uroda to jedna z najpopularniejszych kategorii w AI-shoppingu, presja na kobiety rośnie.

W artykule pojawiają się też głosy ekspertów. Psycholożka i badaczka mediów cyfrowych dr Jenny Radesky podkreśla, iż uzależnienie się od opinii AI może zubożać relacje międzyludzkie i pogłębić niepewność: „Zamiast budować swoje poczucie wartości w relacji z innymi ludźmi, przenosimy je do technologii, która nie ma umiejętności autentycznej empatii”.

NOWA ERA WIRTUALNEJ SAMOOCENY

Dziennikarka zaznacza, iż chatboty – choć same nie inicjują rozmów o wyglądzie – coraz częściej stają się lustrem dla osób niepewnych siebie, szczególnie młodych kobiet dorastających w erze TikToka i selfie. To nowe zjawisko budzi pytania o przyszłość relacji z technologią i nasze wyobrażenie o tym, co znaczy „ładnie wyglądać”.

Wirtualni doradcy mogą oferować chwilową ulgę, ale – jak pisze Hunter – „nie zastąpią bliskości, empatii i realnej rozmowy z drugim człowiekiem”. I choć chatbot może powiedzieć „tak, świetnie wyglądasz w tej czerwonej szmince”, to nie powie: „jesteś wystarczająca taka, jaka jesteś”. A może właśnie to zdanie chcemy naprawdę usłyszeć?

- https://www.washingtonpost.com/technology/2025/05/25/chatgpt-ai-beauty-advice/ ︎